L’insostenibile leggerezza del neodarwinismo

- Ultimissime

- 25 Apr 2012

di Giorgio Masiero*,

*fisico e docente universitario

e Michele Forastiere*,

*insegnante di matematica e fisica

In un recente articolo abbia mostrato i limiti scientifici del neodarwinismo e persino la sua contraddizione con il naturalismo. In aggiunta ai commenti dei lettori apparsi sul sito, abbiamo ricevuto privatamente molte mail con richiesta di delucidazioni e quantificazioni, cui ci proponiamo di rispondere in questo articolo.

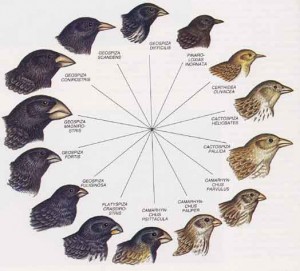

Ricordiamo che il neodarwinismo è riconducibile allo schema monodiano, che vede nel gioco esclusivo di Caso & Necessità, agenti a livello di DNA, le condizioni sufficienti all’insorgenza di organismi sempre più complessi, dalle forme prebiotiche fino all’uomo. Il neodarwinismo identifica il motore dell’evoluzione nella successione graduale di mutazioni genetiche provocate per caso, i cui effetti fenotipici sono poi selezionati col criterio della sopravvivenza del più adatto (necessità). In questa visione, la ricca evidenza paleontologica e genetica dell’evoluzione (la speciazione asincrona di organismi a contenuto informativo crescente insieme alla desunzione di appartenenza di specie simili ad antenati comuni) assegna un ruolo smisuratamente prevalente del caso. L’evoluzione è un fatto, ciò che appare insufficiente è che il caso (più la selezione naturale, che però al livello fisico di DNA assume il ruolo d’improbabile comparsa) sia l’unica risorsa per spiegare l’origine di specie nuove ad informazione genetica crescente e di tutte le forme biologiche esistenti, compreso l’uomo. In altri termini, il caso diventa in questo paradigma l’alibi all’assenza di spiegazioni scientifiche, assume il ruolo di onnipresente “god of the gaps” e rischia di bloccare così linee di ricerca alternative.

L’aberrazione appare particolarmente evidente con la speciazione umana, e in particolare in quello che abbiamo definito “effetto Ramanujan”: vale a dire, nella constatazione che l’abilità matematica umana, intesa come prestazione biologica del cervello di H. Sapiens Sapiens, si è costituita da subito in una capacità sovradimensionata rispetto alle esigenze di fitness selettiva. La soluzione proposta dal neodarwinismo di considerare la capacità astrattiva e matematica umana come un carattere gregario correlato ad un altro genuinamente adattativo (quale per es. il bipedismo) non può essere considerata una spiegazione scientifica nemmeno in termini coerenti con il paradigma, finché non si indica la necessità, ovvero il meccanismo fisico responsabile della correlazione tra i due caratteri. Emerge l’assenza di un’appropriata legge fisica capace di spiegare come ciò potrebbe avvenire, superando la spinta contraria dell’entropia.

Qual è la probabilità che in una popolazione si fissi un carattere (allele) mutato, neutro rispetto alla selezione? La vita, anche al livello più elementare di un batterio, è informazione e in matematica l’informazione non è il caso, ma per definizione il suo opposto. La quantità d’informazione I è collegata alla sua probabilità P dall’equazione di Shannon:

P = 2–I,

da cui si evince che ad un’alta quantità di informazione corrisponde una bassa probabilità e viceversa. Così, se tirando una moneta a testa (T) o croce (C) comunico di aver fatto C, poiché la probabilità dell’evento C è 1:2 = 2-1, l’informazione che ho dato vale 1 bit, che è il quanto minimo d’informazione: c’erano 2 possibilità, T o C, ed ho comunicato quale si è attuata. Se invece comunico una successione esatta di 8 uscite di lancio (per es., TCCTCTTT), poiché la probabilità di questa stringa è 1:28 = 1:256 = 2-8, l’informazione che ora dò vale 1 byte ≡ 8 bit. Con 8 lanci ci sono 256 possibilità equiprobabili, ed ho comunicato quella di 256 che si è avverata: l’informazione è maggiore, vale 1 byte. Un 13 al totocalcio contiene un’informazione ancora maggiore, 21 bit, perché la sua probabilità è 1:313 ≈ 1:221 = 2-21. Maggiore è il numero delle forme diverse in cui un evento può potenzialmente manifestarsi, maggiore è la quantità d’informazione contenuta nella sua forma attualizzata.

Quanta informazione c’è nel genoma umano? Secondo J.C. Venter, esso contiene 3.200 Mbyte, di cui solo il 37,5% (1.200 Mbyte) è utile, perché codificante o comunque composto di geni e sequenze correlate. Quale sottostruttura della “quota utile” è dedicata alle funzioni astratte della mente? Lo “Chimpanzee Genome Project” ha tra i suoi scopi la comparazione tra i genomi degli umani e quelli delle scimmie, per comprendere che cosa distingue i primi. Non è ancora stata eseguita l’intera scansione del DNA dello scimpanzé, ma con riferimento ai campioni finora esaminati (33,3 megabasi del cromosoma 22), la distanza in termini d’istruzioni emersa tra uomo e scimmia è l’1,44%. Assumendo che tale percentuale sia omogeneamente distribuita in tutto il genoma e, soprattutto – secondo una delle assunzioni fondamentali del neodarwinismo – che tutte le differenze tra le specie siano riducibili al DNA, se ne deduce che la “caratteristica” genetica umana sta in 17 Mbyte.

Facciamo ora l’assunzione che la mutazione che porta all’effetto Ramanujan sia dovuta all’apparire casuale di una specifica proteina che regola la crescita e/o la connessione di particolari strutture neurali. Una proteina media ha la lunghezza di 300 amminoacidi ed ogni amminoacido è codificato da 3 basi: dunque, il nostro gene richiede una stringa di 900 bit (abbiamo prudentemente dimezzato i 1.800 bit canonici, tenuto conto che il codice genetico è degenerato, alcune mutazioni sono silenti e molte posizioni lungo la sequenza portano alla stessa struttura 3D). Questo equivale ad assegnare alle funzioni più astratte della mente un peso dello 0,005% sulla caratteristica genetica umana, che sarebbe giudicato forse troppo basso da Aristotele che ripartiva le funzioni vitali in 3 componenti: la vegetativa, la sensitiva e l’intellettiva. Se si deve “soltanto” al caso senza l’azione di una legge selettiva la formazione di questa sottostruttura del genoma, a priori il numero di stringhe è 2900 ≈ 10271, che ripartito in centinaia di migliaia di anni tra decine di migliaia di generazioni di una popolazione totale dell’ordine di alcuni miliardi d’individui (~ 1010) fornisce il valore P ~ 10-261 ≈ 0. Se invece assumiamo l’arco di tempo a partire dall’abiogenesi (~ 3,5 × 109 anni), con l’enzima apparso da subito e rimasto quiescente fino ad oggi in tutti gli organismi derivati dal primo, otteniamo un limite superiore P < 10-221 ≈ 0, tenuto conto che gli atomi della Terra sono dell’ordine di 1050.

Un’altra stima, del tutto indipendente, si può ottenere supponendo che una prima forma del nostro enzima (lunga magari solo un centinaio di amminoacidi) sia apparsa per caso fin dalla nascita della vita – nel cosiddetto “brodo primordiale” – e sia stata poi in qualche modo codificata nel DNA, rimanendo sepolta in sezioni neutre del pool genico complessivo della biosfera fino alla comparsa del primo H. Sapiens Sapiens. Sotto questa ipotesi, possiamo avvalerci del metodo di calcolo delle probabilità messo a punto da E. Koonin e presentato qui qualche tempo fa. Questa volta, nelle ipotesi di Koonin (1021 pianeti adatti a ospitare la vita, un tasso di sintesi di 1 molecola/cm3×sec per un tempo di 10 miliardi di anni), la probabilità della comparsa spontanea di tale proteina da qualche parte nell’Universo, in tutto il tempo trascorso dal Big Bang, risulta dell’ordine di 10‑119. Per un’ulteriore comparazione, può essere utile il calcolo della probabilità di autocomposizione casuale di un organismo monocellulare, che il fisico inglese F. Hoyle eseguì negli anni ‘80, immaginando un modello di batterio astratto con un DNA semplificato, capace di programmare soltanto 400 proteine. Egli trovò P ≈ 10‑40.000, che è un valore compatibile con quello da noi calcolato per una sola proteina, anziché 400. Un valore analogo è stato ottenuto anche dal chimico e genetista americano R. Shapiro nel 1986 per un batterio di 2.000 proteine.

In conclusione, tutti i valori trovati risultano inferiori alla cosiddetta soglia di impossibilità assoluta di 10-100, introdotta dal matematico francese G. Salet. Detto in altri termini, l’effetto Ramanujan, e più in generale la comparsa di una singola proteina, è da considerarsi un evento impossibile, se inquadrato esclusivamente nell’ambito del neodarwinismo. Fu lo stesso F.H. Compton Crick, scopritore insieme a J.D. Watson della struttura del DNA (che valse ai due biologi il premio Nobel 1962 per la medicina), ad ammettere: «Se una particolare sequenza di aminoacidi fu selezionata a caso, quanto raro potrebbe essere un tale evento? […] La gran parte delle sequenze [necessarie al DNA] non potrà mai essere sintetizzata del tutto, in nessun tempo». Queste parole sono la traduzione genetica del dilemma di Wallace, dell’effetto Ramanujan e più in generale dell’enigma dell’origine della vita. Allorché J. Monod, parlando dell’emergenza della vita, scrisse nel suo saggio “Caso e necessità” che «il nostro numero è uscito per caso alla roulette cosmica», si espresse con una metafora adatta forse ad un libro di divulgazione, ma non con la precisione che si richiederebbe ad un saggio scientifico. Per vincere la puntata massima alla roulette, infatti, le probabilità sono 1:37; perché si combini casualmente la più semplice cellula di sole 400 proteine, invece, esse sono 1:1040.000 ≈ 1:3725.507: Monod avrebbe dovuto dire per la precisione che, non tanto “noi” umani, ma già gli organismi unicellulari a capo della catena biologica hanno vinto la puntata massima alla roulette per almeno 25 mila volte di seguito!

S.J. Gould e R. Lewontin sono stati i pionieri nella denuncia del ruolo smisurato giocato dal caso nel neodarwinismo. Chi, come R. Dawkins, si era inizialmente rifugiato nel nebuloso concetto di “cernita cumulativa”, ora ha trovato nelle infinite possibilità di replica fornite dalla metafisica del multiverso, la sua consolazione. Schiere crescenti di scienziati, tuttavia, non si rassegnano a fondare la biologia su basi così anti-sperimentali, e addirittura anti-scientifiche (perché contrarie alle leggi statistiche), solo per non toccare ideologie di moda ed interessi forti: oltre ai “revisionisti”, ci sono molti studiosi che vanno ormai oltre la cosiddetta “nuova sintesi” (fusione di genetica ed evoluzionismo darwiniano) considerandola superata: G. Dover, J. Fodor, E. Koonin, L. Kruglyak, L. Margulis, S. Newman, M. Piattelli Palmarini, C. Woese,… Se non si è disposti ad accontentarsi d’un ricorso ripetitivo alla roulette, se anzi si considera questa scappatoia la via opposta ad un’autentica ricerca scientifica, occorre pensare a qualcosa di nuovo.

Tags:

- accuse neodarwinisti

- contro neodarwinismo

- contro neodarwinisti

- critica al neodarwinismo

- errori neodarwinismo

- evoluzione neodarwinismo

- falsità neodarwinismo

- Neodarwinismo

- neodarwinismo falso

- neodarwinismo ideologia

- probabilità evoluzione

- probabilità vita

- scienza contro neodarwinismo

- scienziati contro neodarwinismo

- tentativi neodarwinisti

137 commenti a L’insostenibile leggerezza del neodarwinismo

Grazie.

Bell’articolo! 🙂

Grazie davvero stupendo

Ottimo, grazie. Avete tradotto in matematica e statistica l’intuizione (vecchia come l’uomo?) che “tutto questo non può esserci per caso”.

Veramente bello e chiaro, Grazie Giorgio e Michele, io mi auguro che questi chiarimenti si trasformino ina ltrettante corazze e scudi per i nostri fratelli che non si trovino in imbarazzo quando venissero assaliti da chi li considera ‘antiscientifici’, ‘retrivi’, ‘superati’.

Un lavoro importantissimo ed esaltante questo.

Un abbraccio

Grazie a te!

Carissimi Giorgio e Michele, questo articolo a mio parere dovrebbe diventare un “classico”, uno di quegli argomenti in grado di mostrare a tutti, esperti e non, la fallacia della Sintesi moderna.

E’ assolutamente necessario che il vostro lavoro venga portato avanti e riproposto il più possibile perché l’unico modo per neutralizzare le conclusioni a cui giungete è quello di non parlarne.

Particolarmente efficace è inoltre il passaggio in cui viene affermato che:

“il caso diventa in questo paradigma l’alibi all’assenza di spiegazioni scientifiche, assume il ruolo di onnipresente “god of the gaps” e rischia di bloccare così linee di ricerca alternative.”

Una frase con la quale si ribalta l’argomento utilizzato contro quel “creazionismo” che pretende di utilizzare l’intervento divino per “mettere una toppa” su quello che la teoria non riesce a spiegare.

Ebbene, in questa frase riuscite a mostrare come la Sintesi moderna (o neo-darwinismo se si preferisce) abbia la stessa scientificità di un dogma fideistico che assume al posto di una divinità il caso e che quindi non è poi così diversa dall’Intelligent design.

Insistiamo ancora tutti su questo punto, i risultati arriveranno.

Grazie a voi, Alessandro ed Enzo. Michele ed io dobbiamo anche a voi, se siamo riusciti ad inquadrare, crediamo in maniera scientifica, il peso del caso nella speculazione neodarwiniana. Ma non ci fermeremo qui. Anche i neodarwinisti con un minimo di cultura scientifica conoscono questi numeri. Essi “credono” tuttavia di compensare l’impossibilità matematica dettata dal caso con l’intervento della “selezione cumulativa”, che renderebbe possibile se non sicuro, anche l’estremamente improbabile. E’ la loro una fede fondata sulla sabbia: ci ripromettiamo in un prossimo articolo di calcolare anche il peso e le implicazioni della cosiddetta selezione cumulativa, completando la pars destruens di una speculazione che da troppo tempo blocca la biologia!

Scopriremo così che, se il darwinismo ha ancora un peso nel mondo scientifico, ciò si deve non alle sue predizioni (nulle), né alle sue applicazioni tecnologiche (nulle), ma paradossalmente soltanto alla sua base filosofica. E’ ora di liberare le scienze biologiche da una concezione meccanicistica ottocentesca, ancora precedente alla relatività einsteiniana e alla rivoluzione dei quanti.

Certo, caro Enzo. Credo che sia importantissimo resistere senza scoraggiarsi, ora più che mai!

Bellissimo articolo!

Un’altra risposta tipicamente data dagli scientisti e la favorita di mio fratello è questa: prima o poi scopriremo un meccanismo naturalistico che ha causato l’origine della vita.

E anche se fosse?

Infatti per me non cambierebbe nulla, ma quando parlo con mio fratello non è possibile ragionarci su.

Tipo un’equazione tensoriale risultante dalla lagrangiana di una teoria risultante dalla rottura di una simmetria SU(n) × SU(m) riguardante i quark della supernova emersa dal vecchio sole da cui è nata la nostra Terra pullulante di vita, Riccardo?

Se è così (e solo di questo tipo può essere, infine, una spiegazione fisica del “meccanismo” della vita) anch’io spero che si riesca un giorno ad avere una teoria scientifica della vita. Ma, a differenza degli scientisti, non mi cullerò in una condizione di saturazione finale, ma pieno di ammirazione verso le leggi matematiche del Creatore, mi volgerò a cercare nuove “spiegazioni” alle nuove domande che ne emergeranno.

Caro Riccardo, per l’appunto anche questa convinzione degli scientisti (che la scienza un giorno riuscirà a spiegare TUTTO senza ricorrere alla metafisica) mi pare essere una forma di fede – una forma non particolarmente razionale, oltretutto. Tra l’altro, mi ricorda un po’ la proposizione S su cui era incentrato l’articolo su Ramanujan…

Sono d’accordissimo Michele, ma te l’immagini se ci fosse un universo dove Odifreddi fosse riuscito davvero a diventare Papa, dove Richard Dawkins è un vescovo anglicano e dove tu, Il professor Masiero ed il professor Pennetta siete dei darwinisti convinti?

No, vabbè scherzo!

Infatti sono d’accordo Prof e suggerisco che anche qualora ci fossero centinaia di universi alternativi questo non eliminerebbe certo il bisogno di un creatore, anzi.

I calcoli matematici sono sempre interessanti e schiaccianti.

Io ultimamente preferisco aggiungere il nuovo approccio, quello della complessità.

Se la cellula è un sistema e se l’organismo è un sistema di organi, di tessuti, di cellule, di reti metaboliche… allora non ha senso concentrarsi sulla mutazione di un dettaglio come foriera della novità di sistema che cerchiamo di produrre.

La mutazione di una proteina può essere efficace solo se è sincrona con un’infinità di altre mutazioni che interessano tutta la sua “rete” con cui interagisce.

Un esempio significativo tratto dalla presunta evoluzione dell’uomo è dato dalla progressiva crescita di volume del cervello: se il canale cervicale dell’utero e il canale del pube non si dilatano in maniera sincrona (con tutti gli annessi di nervi, vasi, muscoli, legamenti…) il feto con la testa “più grossa” muore durante il parto e l’evoluzione si ferma!

Insomma, se la vita è sistema, può trasformarsi in un altro sistema solo per opera di un software.

Sono d’accordo: la considerazione delle interrelazioni può soltanto ridurre ulteriormente il peso del caso nelle probabilità in gioco.

Secondo me all’alternativa neodarwinista che vuole spiegare l’evoluzione con la mutazione casuale genetica e la pressione selettiva ambientale, non si deve necessariamente scomodare il Disegno Intelligente. In ogni caso dal punto di vista della scienza naturale sarebbe improprio discostarsi dal naturalismo. Insomma una vera contraddizione. La scienza naturale deve restare in ambito naturalistico altrimenti smentisce se stessa.

Secondo la teoria epigenetica l’ambiente assume un ruolo rilevante, non dopo l’avvenuta mutazione fenotipica, ma durante. E questa è l’opinione anche di Lewontin. Inoltre la stessa biologia è passata al Progetto Proteoma, appunto perchè ha rilevato le varie incongruenze della teoria dell’informazione applicata al genoma, in particolare a quello umano. Per quanto riguarda il cervello umano, l’antropologo Marvin Harris ha avanzato una teoria che possa spiegare la maggior grandezza del cervello umano rispetto a quello di uno scimpanzè e degli ominidi in generale. Harris parte dalla constatazione che il cervello dell’erectus era più grande del 33% di quello dell’habilis. Ma la teoria del maggior progresso tecnologico non poteva spiegare perchè l’erectus fosse più intelligente dell’habilis, anche perchè in più di un milione di anni lo strumentario dell’erectus rimase pressochè inalterato. Ma anche se gli strumenti dell’erectus erano più sofisticati di quelli dell’habilis, ciò non poteva giustificare un aumento così smisurato del cervello del primo rispetto all’ultimo. In parole povere: che se ne faceva l’erectus di quel 33% di cervello in più rispetto al più arcaico habilis? Ovvero quale contributo a livello di sopravvivenza poteva dare all’erectus un cervello più grande, il quale in condizioni di riposo è responsabile del 20% dei consumi metabolici di un uomo? La risposta (devo dire ingegnosa) in realtà la diede un certo Konrad Fialkowski: all’erectus quell’enorme cervello serviva per correre.

all’erecta invece serviva per tenere delle lunghe conversazioni, per registrare in memoria le confidenze delle altre erecte, per fare all’erectus un gran numero di raccomandazioni e discorsetti prima che filasse via di corsa, nonché per tener fronte all’entropia e mettere in bell’ordine nei suoi cassetti cerebrali un crescente numero di bit informativi…

ciao Antnonio

*Antonio

scusa

Bellissimo, Topazia! I neodarwinisti parlano esattamente come te, ma prendendosi sul serio e chiamando scienza il loro discorrere.

Grazie Professore! se troverò qualcuno che ‘parla come me’ cercherò di tenerlo a debita distanza 🙂

Ciao Topazia.

Hai mai corso una maratona o visto un maratoneta correrla?

Ebbene le cellule cerebrali sono più suscettibili allo stress termico delle altre cellule. La perdita di efficienza neurale, dovuta al maggior stress termico, porta al disorientamento mentale, alle convulsioni, al collasso e infine alla morte. Ma l’Homo Erectus ancora non aveva a disposizione strumenti per colpire le prede alla lunga distanza ed era quindi costretto a rincorrerle, semmai dopo averle ferite avvicinandosi e rischiando la pelle (ma non aveva alternativa per sopravvivere). Fino a poco tempo fa e forse ancora oggi la tecnica dell’inseguimento è applicata da certe tribù nel deserto del Kalahari. Quindi l’Erectus era costretto a rincorrere la preda, anche per giorni, in modo di arrivare prima che i predatori se ne impossessasse. Infatti una delle caratteristiche umane è proprio la resistenza alla corsa. E qui viene in aiuto proprio la teoria informatica. Uno dei suoi principi fondamentali dice che se un sistema informatico ha elementi inclini a perdere efficienza l’attendibilità del sistema può essere aumentata proprio aumentando il numero degli elementi e delle connessioni. E’ così pare che sia avvenuto anche per il cervello dell’Homo Erectus, e proprio a causa di una questione di sopravvivenza. Una dimostrazione moderna è data dalle cure dei malati di Parkinsons. La farmacologia che aiuta a diminuire i movimenti involontari di questi malati incide alla lunga e pesantemente anche sulle loro capacità cognitive. Quindi i circuiti neurali che comandano l’attività motoria e le capacità cognitive sono intimamente intrecciati. A questo proposito una volta vidi un documentario di un nuovo sistema pedagogico sperimentale attuato in Germania o forse nella Svizzera tedesca, che impartiva le lezioni a dei bambini in costante movimento fisico. Pare che dagli studi le loro capacità cognitive fossero in media superiori rispetto a quelle dei coetanei che frequentavano scuole tradizionali.

tutto ‘sto casino di neuroni per un po’ di calore.

Ci si metteva qualche dissipatore e via! 😉

Piu’ seriamente, ma dici sul serio? E perche’ allora non aumentare semplicemente la superficie del cranio, magari con qualche bella cresta, invece del cervello? O le meningi? o il liquido intracranico?

Un chip scalda troppo, allora che facciamo? Anziche’ dissipare meglio il calore, ce ne mettiamo uno piu’ potente!

Uno dei suoi principi fondamentali dice che se un sistema informatico ha elementi inclini a perdere efficienza l’attendibilità del sistema può essere aumentata proprio aumentando il numero degli elementi e delle connessioni.

Ecco un ottimo modo per aumentare i fault.

Una vecchia regola non scritta dice “quello che non c’e’ non si puo’ guastare”.

No, dico…

Ma stai dicendo sul serio o ti diverti a ca***giare?

Fino a poco tempo fa e forse ancora oggi la tecnica dell’inseguimento è applicata da certe tribù nel deserto del Kalahari.

E che dimensione del cervello hanno queste tribu’?

Infatti una delle caratteristiche umane è proprio la resistenza alla corsa

Infatti…

Infatti una delle caratteristiche umane è proprio la…

… capacità di adattamento. Del resto, guardando agli scandinavi o ai sovietici, verrebbe da pensare che la principale caratteristica umana sia quella di sradicare alberi dal terreno o lottare a mani nude con con gli orsi. Io pertanto eviterei di generalizzare in questo modo.

Immaginare poi l’homo erectus come un ominide che passasse le sue giornate a far maratone per la savana mi sembra quantomeno azzardato. Immagino che, da cacciatore, abbia dovuto escogitare dei sistemi per rendere le battute di caccia più efficienti possibile, dovendo magari -a tal fine- comunicare con i suoi simili, sviluppando in questo modo il linguaggio, il che avrebbe potuto portare ad un aumento del volume cerebrale. Solo congetture eh, sia chiaro…

Ah..ho capito, divertente.

Forse ti sembrerà strano ma l’erecta correva assieme all’erecto, perchè per sopravvivere ci si deve anche riprodurre (salvo appunto durante la gravidanza).

Ancora oggi non c’è questa grande differenza tra la resistenza fisica alla corsa di una donna rispetto ad un uomo.

Record nel mondo dei 10000 metri piani UOMINI: 26’17″53 di Kenenisa Bekele

Record nel mondo dei 10000 metri piani DONNE: 29’31″78 di Wang Junxia

3 minuti e rotti mi sembrano una discreta differenza, Antonio caro.

Ciò significa che la femmina erectus era più robusta della femmina sapiens.

In parole povere la donna si è rammollita in seguito e proprio per le ragioni esposte da Topazia.

Giulia cara..

Guarda che Topazia era chiaramente ironica, come tu stesso hai riconosciuto 🙂

L’ironia talvolta racconta più verità di qualsiasi discorso serio.

Il solito svicolone! Invece di rispondere si attacca alla forma.

Non si tratta di svicolare. E’ che l’erectus basava la sua dieta sulla caccia e quindi era costretto a macinare decine di chilometri al giorno. Se ne deduce che la vita di una femmina e quella di un maschio erano molto simili. Diciamo che c’era perfetta parità di genere.

le mie connessioni informatiche purtroppo non sono molto evolute..

Confesso che non son ferrata in paleantropologia,però Wiki dice nella specie H. erectus “Il dimorfismo sessuale tra maschi e femmine era leggermente più marcato di quello dell’H. sapiens, dato che i maschi erano più grandi delle femmine” (… comunque meno marcato che nell’australopiteco).

Se ne può dedurre che l’erecta correresse dietro all’erectus.. a meno che per riportarsi in parità, non gli rifilasse la prole..

ciao Giulia!

Ma il fisico di un maratoneta non deve essere quello di un centrometrista. Non confondere l’esplosività della potenza fisica necessaria per una corsa rapida sulla breve distanza con la resistenza sulla lunghissima distanza. Nella prima i campioni sono i grandi predatori quadrupedi, nell’ultima l’uomo.

Cmq è chiaro che era il maschio il cacciatore che affrontava la preda e probabilmente stava davanti alla femmina che cmq doveva seguire, anche se con ritardo.

Come tutti i cacciatori-raccoglitori non stanziali la prole doveva essere scarsissima. Più che prole parlerei di un solo cucciolo. Cmq la selezione naturale ha di certo selezionato femmine dotate di elevata resistenza alla corsa. Le altre semplicemente non sopravvivevano e forse (ma questa è una mia ipotesi) la cosa veniva agevolata dal gruppo.

Tutte queste “conoscenze” e assunzioni sullo stile di vita dell’homo erectus mi ricordano tutti i pregiudizi ideologici che per anni si sono borbottati sugli uomini del passato:

Gli egizi non avevano i mezzi per costruire le piramidi. Le gru le abbiamo inventate noi, e all’epoca avevano solo il legno perche’ erano sfigati. E giu’ le teorie dei giganti e degli Atlantidei… E poi? Poi si scopre che eravamo noi gli stupidi a credere che servissero le gru:

http://news.nationalgeographic.com/news/2007/04/070402-great-pyramid.html

Gli antichi popoli del Sud America (bianchi poi estinti con migrazioni successive) non avevano i mezzi per attraversare 6mila km di oceano e raggiungere la Polinesia. Le tecniche marinare le abbiamo inventate noi. Loro erano aborigeni sfigati. E giu’ teorie di evoluzione spontanea in Polinesia dalla scimmia all’uomo, stretti di Bering locali e altre castronerie. E poi? Poi uno storico norvegese propose che i popoli del Sud America ci andarono con una zattera. Deriso da tutti i suoi colleghi storici radicati alle loro posizioni come spesso in ambiti universitari, raduna 5 amici, fa una zattera con le tecniche dell’epoca e attraversa l’oceano nella storica spedizione del Kon-Tiki:

http://en.wikipedia.org/wiki/Kon-Tiki

L’elenco non si ferma certo qui. Pensaci meglio prima di dire che il cervello era solo un contrappeso utile alla corsa.

Non raccolgo le varie provocazioni più o meno gratuite.

Volevo solo sottolineare (anzi ribadire) che non è affatto una mia ipotesi quella di cui andate cianciando tra di voi, ma di un antropologo contemporaneo, scomparso nel 2001, Marvin Harris.

Giusto per non prendermi dei meriti che non mi spettano.

Cmq è chiaro che era il maschio il cacciatore che affrontava la preda e probabilmente stava davanti alla femmina che cmq doveva seguire, anche se con ritardo.

Ma e’ una palese assurdita’!

Quando mai si e’ vista una caccia con la femmina che seguiva (e magari i pargoletti attaccati al seno) l’uomo che correva dietro l’animale!!! E poi che facevano, se la mangiavano correndo?

Mi sembra ovvio che gli uomini partivano insieme per una battuta di caccia, che magari durava anche giorni, e poi tornavano indietro, ai “villaggi” dove c’erano le donne che aspettavano.

E che si portavano dietro tutti gli attrezzi (con tutto quelo che c’e’ voluto per realizzarli!), le pelli, i giacigli, ecc?

Come tutti i cacciatori-raccoglitori non stanziali la prole doveva essere scarsissima. Più che prole parlerei di un solo cucciolo.

Sarebbe d’uopo che tu fornissi qualche esempio di “cacciatore-raccoglitore”, a parte l’uomo.

La prole doveva essere scarsissima? E’ strano… io gli zingari (o “rom”, che e’ politicamente corretto) li ho sempre visti attorniati da decine di bambini! 😀

Un solo cucciolo? cosi’, se moriva, erano spacciati. compliemnti.

Non raccolgo le varie provocazioni più o meno gratuite.

Dovresti piantarla di fare il saccentello presuntuoso, che solo per il fatto che uno ribatte ad una tua teoria (anche se riportata) ti offendi e non rispondi nel merito.

Ti hanno fatto una decina di obiezioni, e non hai risposto a nessuna.

Volevo solo sottolineare (anzi ribadire) che non è affatto una mia ipotesi quella di cui andate cianciando tra di voi, ma di un antropologo contemporaneo, scomparso nel 2001, Marvin Harris.

Parli di questo?

http://it.wikipedia.org/wiki/Marvin_Harris

curiosa la sua “preparazione”:

ebbe una grande influenza nello sviluppo del materialismo culturale, combinando l’enfasi di Karl Marx sulle forze produttive con le intuizioni di Thomas Malthus sull’impatto dei fattori demografici sugli altri aspetti del sistema socioculturale.

E cmq ti hai detto che non c’è gran differenza tra uomo e donna nella resistenza, e io ti ho portato dati chiaramente contro la tua immaginifica tesi. Nulla da dire?

Ho detto che non c’era questa grande differenza, non che non c’era differenza. E’ l’aggettivo “grande” che ti frega.

E poi se credi che tre minuti siano tanti, provati a correre 10 chilometri senza fermarti. In ogni caso l’erectus non aveva il lusso di scegliere. Questa teoria spiega anche il diverso sistema di raffreddamento dell’uomo… in parole povere il sudore.

Guarda che i tuoi dati non scalfiscono di un grammo la tesi di Antonio. Sono dati relativi a dei record di altetica e dimostrano solo che il più veloce tra gli atleti _maschi_ registra tempi registra migliori della più veloce tra gli alteti femmine. Adesso magari vai anche a guardarti quanti sono gli atleti maschi in totale e quanti quelli femmine; e poi magari applica il teorema di Bayes, perché si fa così. Avrai delle sorprese.

Voi avreste delle sorprese ancora più grandi se andaste a vedere le gare di fondo maschile e femminile… tre minuti di differenza sono tanti, anche in percentuale.

chi ha detto che non sono tanti? e che c’entra la “percentuale”?

Antonio ha detto che non c’è “grande differenza”, non hai letto?

Di quello che ha detto Antonio, che il cervello piu’ grande servisse a dissipare meglio il calore durante le corse, a me…

http://www.youtube.com/watch?v=QwhYkB2fTDI

😉

se e’ per quello, allora dovremmo dire tra gli atleti _maschi_ che hanno fatto gare omologate perche’ anche io potrei essere piu’ veloce di loro senza saperlo (si’, forse rotolando sulla panza!).

Giusto. Ma seguendo i ragionamenti di Giulia, uno dovrebbe concludere che i cinesi sono atleticamente e fisicamente tra i più dotati atletici del pianeta, dato che alle ultime olimpiadi si sono portati a casa più medaglie d’oro di tutti. Curioso che le doti intrinseche dei cinesi siano emerse in occasione dei giochi olimpici a Pechino…

Non vedo in che modo tu sia approdato a questa conclusione, non ne ho fatto un questione di etnia, ma di sesso.

ah ecco; il criterio dei record mondiali si applica solo al sesso, non all’etnia.

Eh?

I record mondiali si dividono per sesso, mi pare ovvio; cmq chiudiamo qua l’OT.

Ma non e’ che stai confondendo l’Homo erectus con l’Homo di Neanderthal?

Forse ti sembrerà strano ma l’erecta correva assieme all’erecto

Eh si’…

Facevano come Benny Hill…

Sarebbe da chiedersi a cosa servissero al Neanderthal 1500 cc di materia grigia…

Gli esempi matematici sono sempre forti.

Io credo che si debba insistere di più, comunque, sul fatto che ogni dettaglio degli organismi viventi acquista senso e identità solo nel contesto.

Per cui, se vogliamo trasformare e fare evolvere la vita, dobbiamo lavorare sull’intero contesto.

A questo punto la probabilità che tutto il sistema si trasformi in un altro sistema dotato di senso è certamente nulla.

@Antonio72, Umberto Fasol

Certamente una teoria scientifica dell’origine della vita e delle specie non può basarsi sull’ID, per definizione di metodo scientifico. Né, ancora per definizione, può avere una base diversa dalla scienza fondamentale che è la fisica. Quindi una teoria scientifica dell’origine della vita e delle specie non può basarsi sull’antropologia, o l’ecologia o… la stessa biologia, o anche la chimica e pertanto quelle di Lewontin, Harris, Fialkowski & C. sono solo chiacchiere in lingua inglese. Occorre partire dalla fisica, e questa deve essere una fisica dei sistemi, perché come insiste correttamente Fasol, gli organismi sono sistemi. E in questa teoria fisica, Fasol, servirà cmq moltissima matematica.

E’ vero che gli organismi sono sistemi, ma con vari gradi di complessità. Non ho poi ben capito perchè debba essere solo la fisica a spiegare l’origine della vita. Se un domani si riuscisse a creare una cellula in un laboratorio chimico, cosa sarebbero, chiacchere? E’ vero che la fisica è la scienza fondamentale di tutta la realtà, quindi anche degli esseri viventi, ma credo che per spiegare la maggior parte delle funzionalità di questi ultimi la biologia e la chimica siano scienze più adatte della fisica. La scienza è per definizione anche multidisciplinare.

Perché la fisica? Perché tutta la natura è fisica alle origini, Antonio! E qui il tema è quello delle “origini” della vita da materia inanimata (cioè dai 92 atomi), e quindi occorrerà partire dalla scienza dei fondamenti, la fisica appunto. Poi è ovvio che, per descrivere sempre meglio le funzionalità degli organismi (già dati), si salirà alla chimica, alla biologia, ecc.

I chimici non hanno mai fatto l’errore di chiedersi l’origine degli atomi, ma hanno demandato il problema ai fisici, mentre i chimici si sono occupati di studiare le proprietà delle possibili combinazioni degli atomi già dati (le molecole). E i fisici hanno scoperto la nucleosintesi stellare che all’interno delle stelle porta, attraverso un cammino preciso descritto da leggi matematiche, alla costruzione degli atomi: idrogeno, elio, litio, ecc.

Se non si sa niente ancora sull’origine della vita (e se genetisti, antropologi e zoologi non vogliono tra un secolo continuare a fare la figura di Dawkins di qualche giorno fa che, dopo aver congetturato, pontificato, immaginato, panspermizzato il cosmo, ecc., ecc., a domanda precisa ha riconosciuto infine: “non sappiamo nulla sull’origine della vita”), è perché se ne è occupata gente senza l’armamentario scientifico adatto. E’ ovvio, poi, che trattandosi con la vita fin dalle origini di organismi complessi, servirà accoppiare una teoria fisica (dello stato solido) con la matematica dei sistemi complessi.

Tutto il resto sono chiacchiere cui meravigliosamente ha controbattuto Topazia. Meglio piuttosto rifugiarsi come i battisti sulla lettera della Bibbia, dalla quale avremo cmq molte cose più importanti da imparare.

Ciao Giorgio,

sono pienamente d’accordo con te che la rinascita della biologia dovrà partire dalla fisica, ormai infatti i biologi sono così autoreferenziali che non riescono più a guardare oltre le loro teorie cristallizzate.

Lo dimostra anche il fatto, testimoniato da Alessandro Giuliani, che le ricerche innovative vengono rifiutate dalle riviste di biologia e accettate invece da quelle di chimica e fisica.

Un precedente significativo è quello di Schrodinger che con il suo libro “Cosa è la vita” ipotizzò l’esistenza del DNA fornendo a Watson e Crick le basi teoriche per la loro successiva scoperta.

Quando la matematica e la fisica metteranno irrimediabilmente in crisi la Sintesi moderna anche i più ostinati neodarwiniani dovranno arrendersi all’evidenza.

Buon lavoro!

Sì, caro Giorgio. Ma la matematica non può includere nei suoi simboli il progetto presente nella cellula e in ogni organismo, che è la miglior definizione della vita, che ha dato Monod, ma che riprende anche Boncinelli in tutti i suoi innumerevoli libri. In questo senso ritengo che la teleonomia degli esseri viventi sia così importante e ricca di informazioni da non poter essere descritta da alcuna equazione. Le supera tutte.

Come sia nata non lo sappiamo. E non lo sa nemmeno l’ID.

Quindi, se per una singola proteina valgono i calcoli che hai fatto nell’articolo insieme a Michele… bè, è facile inferire che per un progetto valgono all’ennesima potenza.

Credo che le nostre considerazioni si possano affiancare.

Ma la teleonomia dei viventi si colloca su un piano diverso dalla fisica.

La rispetta, se ne serve, ma la trascende.

Così come nè la legge di gravità, nè alcuna forza fondamentale della natura sono in grado di descrivere il senso (inteso come progetto) di alcuna cosa che esiste.

Ne costituiscono solo un ingrediente. Almeno così mi pare.

Caro Umberto, io come te riconosco i limiti della ragione umana, ma non so dove essi siano, e quindi non riesco a stabilire “a priori” un limite nella ricerca scientifica. Per es., sappiamo in base ad un teorema di Gödel, che non tutte le verità matematiche sono dimostrabili, però questo non impedisce ai matematici di cercare di dimostrare, che so, la congettura di Goldbach…, e questo perché nessuno sa a priori quali siano le verità matematiche indimostrabili!

Così, per quanto riguarda la vita, io sono pieno di ammirazione per la varietà e la complessità dei diversi organismi in cui essa si esprime, però nessuno di noi può sapere a priori se davvero “la teleonomia degli esseri viventi sia così importante e ricca di informazioni da non poter essere descritta da alcuna equazione”, magari parzialmente, se non interamente.

insomma,vi siete smascherati in un articolo che e’ del tutto inconsitente filosoficamente,perche’ non fa che ribadire il concetto di quanto sia improbabile la vita umana cosi com’e'(e chi lo ha mai negato? e allora?),scientificamente inutile perche’ parte da un assunto del tutto opinabile (la vostra famosa proteina,ma un esempio del genere non fa che mettere in risalto la vostra incompetenza e faciloneria) quando non evidentemente e chiaramente falso : “la prestazione biologica del cervello di H. Sapiens Sapiens, si è costituita da subito in una capacità sovradimensionata rispetto alle esigenze di fitness selettiva..”. Affermazione quest’ultima particolarmente grave nella sua falsita’..come se gli evoluzionisti potessero decidere quali sono tali esigenze a partire da uno schema puramente teorico…davvero pazzesco.Chi vi ha detto poi che il cervello di homo sapiens si sarebbe costituito “da subito” ?? ah ah roba da pazzi ragazzi…roba da pazzi…

Ce lo dicono i fossili. A meno che tu non voglia immaginare che la scatola cranica, ovvero ciò che ci rimane, contenga un cervello molto più piccolo dello spazio in esso contenuto, in tal caso sarei curioso di conoscere le basi di tale affermazione.

Inoltre sono, come dire, sbalordito dalla frase “come se gli evoluzionisti potessero decidere quali sono tali esigenze a partire da uno schema puramente teorico”. E allora che ci stanno a fare? Sono degli scienziati anche loro o no? O vuoi dire che siccome il caso genera il caso allora non è possibile stabilire nulla ed è meglio andare tutti a casa, scienziati compresi, tanto nessuna scoperta archeologica può mettere in dubbio questo assunto? Penso che sarebbe molto più coerente.

A proposito della proteina, siccome hai giustamente detto che è qualcosa di opinabile, ti invito a fare un calcolo opposto, che riabiliti la teoria del caso dal punto di vista statistico (sarebbe la prima volta in tal senso): calcolando il tempo a disposizione per l’abiogenesi e le probabilità di ottenere una sequenza biologicamente utile, quanti aminoacidi poteva contenere al massimo la prima proteina? Fai attenzione al calcolo esponenziale e logaritmico, è molto insidioso. Buona fortuna!

i fossili???? semmai i crani veri e propri che documentano il progressivo aumento del volume,di diverse specie di ominidi tra l’altro,presenti contemporaneamente…ma che scrivete?? quali fossili???? ah ah

I fossili mostrano un abisso di capacità cranica con la comparsa del ramo degli uomini denominati “heidelbergenses”, e il fatto che gli erecti fossero contemporanei cosa significa? E’ stata proprio questa valutazione a separare i due rami evolutivi!

ma quale abisso? ma per piacere…siamo partiti dalla vostra “prova ontologica”..adesso tirate fuori l'”anello mancante”…ah ah

abisso non certo rispetto alle capacita’ logiche o di astrazione visto anche gli uomini di Neanderthal pare avessero elaborato una sorta di culto dei morti…e pare appartengano ad un’altra linea evolutiva…. !

del resto (di rami evolutivi) di ominidi se ne contano almento 5,per quanto se ne sa.

Devo rilevare che il vostro modo di impostare il discorso denuncia una sostanziale incompetenza sul rapporto tra DNA e proteine. Pensare che abbiamo a disposizioni esempi meravigliosi..vedi ad esempio quel singolo nucleotide che nelle aree un tempo infestate dalla malaria e’ responsabile dello sviluppo dell’anemia falciforme (i globuli rossi falciformi sono un po’ piu’ resistenti di quelli normali all’infezione da plasmodio)…e’ con queste osservazioni sul campo che si fa la scienza..non con le prove di sant’anselmo…

sono veramente sconcertato dal vostro atteggiamento. mi chiedo a chi vi possiate rivolgere…

Non so a chi ci possiamo rivolgere. In compenso grazie al suo intervento ora so benissimo a chi deve rivolgersi chi spaccia la selezione di un gene difettoso come prova di aumento dell’informazione.

Dunque:

1)Quale sarebbe la prova ontologica citata nell’articolo?

2)Ella, nella Sua infinita e divertita sapienza (se l’è andata a cercare con il Suoi tono) sarebbe in grado di fornire calcoli diversi e contrari? La invito a farlo, nel caso, perché non si dica che non è capace di confutare con argomentazioni coerenti ed adeguate.

3)Apprendo volentieri che il culto dei morti è sinonimo di astrazione e capacità logiche: un tipo di culto dei morti fece anche qualla scimmia che visto morto il suo amico gatto chiamato “Tuttopalla” lo cullò ed accarezzò teneramente ed a lungo finché non le fu tolto. Ricorda? E’ peraltro consolante che tali capacità di astrazione appartengano a scienziati moderni e non oscurati dalla fede.

4)Sull’incompetenza sul rapporto DNA – proteine dovrebbe essere più esplicativo, le nostre menti oscurate non capiscono, e soprattutto non capiscono che cosa c’entri l’anemia falciforme, prima di tutto per il fatto che si tratta di un gene in generale svantaggioso e vantaggioso soltanto in certe condizioni e che tali condizioni lo hanno mantenuto,ma non a scapito del gene “normale”, benché svantaggioso (peraltro svantaggiosissimo per circa la metà della popolazione, quella maschile, che già in passato avrebbe preferito forse qualche dose di chinino a crisi emolitiche anche letali: questo a proposito di eventuali mutazioni selezionate a distanza di tempo dalla loro comparsa); in ogni caso, per inquadrare correttamente il rapporto DNA-proteina e per nostra informazione, ci può citare qualche altro (anche uno solo) caso di osservazione di mutazione genetica umana vantaggiosa e correlata all’ambiente come quella dell’anemia falciforme? Sicuramente sì, visto che parla di esempi meravigliosi (anche se non si capisce dove gli autori dell’articolo avrebbero sbagliato nell’inquadrare il citato rapporto).

6)Non so a chi ci possiamo rivolgere noi, ma per Lei avrei ottimi suggerimenti…

Scusa Antonio ma occupandomi di Parkinson posso assicurarti ke le cose non stanno proprio come le hai descritte per questo delle volte fare esempi errati porta a conclusioni errate

Scusate, ma il vostro articolo è stato pubblicato su quale rivista scientifica?

E’ più o meno ciò che dicevano i detrattori di Einstein venti anni prima che fosse riconosciuta la predittività delle teorie della relatività.

Ora, poiché a giudicare dal commento la tua casa traboccherà di migliaia di numeri cartacei di Science, Nature, Scientific American, National Geographic, “Le Scienze” e altri titoli estremamente autorevoli, potresti fare una ricerchina anche per noi, e vedere se in quelle pagine l’argomento viene trattato in modo esauriente, magari giungendo a una conclusione opposta?

Sai, a me a scuola avevano insegnato che il sorgere dell’era scientifica aveva abolito l'”ipse dixit” e il principio di autorità… evidentemente, o in pochi anni è cambiato il sistema scolastico, oppure la ‘comunità scientifica’ ha deciso di cambiare politica.

guarda che la relatività di E. era stata pubblicata subito sull’Annalen der Physik, una rivista scientifica internazionale. Per cui i detrattori di E. non potevano certo accusarlo di non aver pubblicato il suo lavoro (infatti non hanno mai sostenuto questo).

Anche perché, se non l’avesse pubblicata, nessuno si sarebbe mai scomodato a riconoscerne (o disconoscerne) il potere predittivo.

Gentile signora, il presente articolo è un lavoro che definirei “di complemento tecnico” alle considerazioni epistemologiche che presentammo qualche tempo fa su questo stesso sito (https://www.uccronline.it/2012/04/03/effetto-ramanujan-un-argomento-evolutivo-contro-il-neodarwinismo/). Il contenuto scientifico di quanto qui esposto è invece ampiamente e banalmente noto a chi si occupa di evoluzionismo; per darle solo un’idea, la indirizzo a questo articolo di Eugene V. Koonin sull’abiogenesi: http://www.biology-direct.com/content/2/1/15.

Cordiali saluti

Buongiorno,

da buon ateo mi auguro che questo articolo possa uscire dallo spazio di questo sito ed essere verificato e valutato in maniera indipendente. Se fosse riscontrata la veridicità di quanto affermate sarebbe un risultato davvero importante.

Cerco di uscire anch’io dal sarcasmo. Vorrei esattamente sapere il significato della parola “indipendente”. Tanto per essere chiari, essere atei non vuol dire necessariamente essere privi di pregiudizi ed essere credenti non vuol dire necessariamente manipolare i dati in esame. Inoltre ci tengo a precisare, come ha detto il prof. Forastiere, che i calcoli di Koonin, Hoyle e degli altri personaggi citati nell’articolo sono ampiamente noti a chi si occupa della materia.

Su ciò che avevo detto precedentemente sull’ipse dixit, credo che 2+2 faccia 4 anche se questo non sarà il titolo del prossimo numero di Science, e che se una determinata ricerca è pubblicata su Nature non significa che non possa essere macchiata da errori anche grossolani e fraintendimenti di varia natura. Più volte mi è capitato di farmi grasse risate al riguardo.

Vinci spesso, vinci adesso. E’ la pubblicità del gratta e vinci. Io l’ho provato e so che le vincite minime, quelle più frequenti, vengono poi rigiocate nella speranza di ottenere una somma più cospicua. Non che ci tenessi, le poche volte che vincevo mi sono servite ad “arrotondare” le spese. Con venti euro potevo giustificare l’acquisto di un libro, altrimenti mi arrangiavo.

Perchè ne parlo? Perchè questa roulette della vita presentata nell’articolo a me ricorda il flusso di denaro che circola nelle tasche dei boss nei vari commerci illegali. Quante giustificazioni ho sentito sul gioco dell’azzardo? Se vinci ti sistemi per tutta la vita!

Siamo seri e non giochiamo a fare come Dio, nel decidere chi vive e chi muore. I calcoli della probabilità sono quelli di chi stabilisce un finalismo: quante probabilità ci sono di vincere all’enalotto? Pochissime. Ma se giocassi milioni di volte, cioè quel che serve per fare sei, prima o poi vincerai.

Nel caso della comparsa della vita, cioè del “Gene egoista” di Dawkins, nell’articolo viene dato per scontato il finalismo rivolto all’uomo. Ma quanta probabilità c’è che alla fine dovesse comparire l’homo sapiens e che la natura fosse stata perfetta come nell’Eden biblico? Siamo seri anche qui: una probabilità milioni di volte più bassa rispetto al puro caso darwiniano! E questo articolo sarebbe scienza?

La confusione tra matematica e biologia è la stessa che nell’ambito della fisica sta facendo impazzire centinaia di scienziati: c’è una teoria, cd. “del tutto”, che matematicamente unifica relatività e meccanica quantistica, eppure non ha portato nulla di concreto, nessuna previsione verificabile, nessuna congettura falsificabile. In fisica è diventata famosa la frase “In pratica funziona, ma in teoria?” E non era riferito alla vita, bensì alla materia inerte. Ma nessuno si azzarda a dire che la fisica è da buttare come invece si dovrebbe fare con la biologia darwiniana.

In concreto, cosa significano quei numeretti della biologia? Dunque…

1) la comparsa della vita. Più e più volte nel corso dei 13,7 milioni di anni dal big bang si sono presentate le condizioni per la creazione di geni dal nulla. L’esperimento è perfino ripetibile in laboratorio.

2) l’evoluzione. Il finalismo equivale al principio antropico della fisica, che dice che se ci troviamo in questo particolare universo è solo perchè le condizioni iniziali lo permettevano. Invece dobbiamo abbandonare l’idea che l’aumento delle dimensioni del cervello sia “finalizzato”. Prendiamo il condice genetico e domandiamoci, come fanno gli scienziati seri: quante probabilità ci sono che sia copiato in modo identico di madre in figlia, nei batteri? Molte di meno rispetto a quelle degli errori di copiatura! E’ questo il dato onesto, che viene celato.

3) la selezione. Mancando un finalismo, non possiamo più dire quali errori di copiatura saranno determinanti per il futuro. Per lo più le mutazioni sono neutre. Ma quando il mondo si rivolta contro il batterio, qualunque cosa significhi “mondo”, allora alcuni sopravvivranno e trasmetteranno i geni “mutanti” che hanno permesso la sopravvivenza. Quali geni? Nessuno in particolare. L’argomento abusato della rarità di mutazioni favorevoli fa dimenticare che le altre mutazioni hanno portato alla nascita frequente di Freaks, fenomeni da baraccone. Se invece diciamo che nessuna mutazione è determinante, allora questi freaks acquisiscono una dignità che perdono nella concezione finalistica della natura.

4) il caso. Qui arriviamo all’autentica eresia darwiniana, a cui non viene perdonata l’esclusione di Dio. Eppure un’attenta delucidazione sulle leggi scientifiche del caos fa capire come la stragrande maggioranza degli eventi che noi attribuiamo al caso, in realtà ha delle leggi nascoste che non riusciamo a intuire. La metafora della fisica è quella dell’orizzonte degli eventi: chi sta più in alto ha una visuale più ampia e quindi è in grado di fare previsioni più attendibili. Attraverso la ricerca, l’uomo è in grado di ridurre il caso ai minimi termini. La vera sfida è vedere fino a che punto ci riesce. Se i fondamentalisti religiosi non tentassero ogni volta di scimmiottare la scienza, accusata di essere un covo di atei (embè? sempre ci sono stati religiosi e atei, perchè descriverli in modo caricaturale?), allora potrebbero sollevare l’argomento pertinente sulla cima di questo orizzonte degli eventi: Dio o il Puro Caso? Qui la filosofia ha imbastito un dibattito serio, “Perchè c’è qualcosa piuttosto che nulla?”.

continuo a essere sconcertato dal modo in cui si fa “divulgazione” pseudoscientifica in questo sito. abbiamo visto la “scienza tedesca” al lavoro…cosa sarebbe questa..la “scienza cattolica” ?!? con la censura a chi non la pensa come voi ?

penso che dovreste porvi qualche problema etico se questo e’ il vostro modo di spiegare ai vostri amici la teoria dell’evoluzione.come vi dicevo nella storia del 900 queste cose le abbiamo gia’ viste…

Qui non si fa nessuna divulgazione pseudoscientifica, e penso ci voglia un bel coraggio a parlare di “scienza cattolica”. La scienza è di tutti e di nessuno, e si presume che sia una cosa risaputa. La cosa che avviene su questo sito è cercare di mettere in guardia l’uditorio da chi propone la scienza come arma contro le opinioni (non solo contro le religioni), avanzando argomenti inesatti. Nel caso specifico, quello di dire “grazie al caso e alla necessità -guarda caso due termini contraddittori- può emergere qualunque cosa in un determinato lasso di tempo NON è un’affermazione scientifica: deve essere vagliata. Alcuni specialisti omettono questa cosa perché è sconveniente; dirlo chiaramente è esattamente ciò che un sito di opinione indipendente deve fare, e mi sembra lo stia facendo abbastanza bene, nonostante tutto.

Non penso neanche che la redazione censuri chi non la pensa come noi, visto che abbiamo spesso ospiti atei rispettosi ed educati. Tenere pulito il sito da chi si presenta solo per diffamare apertamente chi propone un opinione mi sembra il dovere minimo di ogni buon moderatore.

Più che altro le stiamo vedendo… come vede, tuttavia, Lei non è censurato (e ci mancherebbe, sta rappresentando nel miglior modo quasi tutto ciò che di negativo andiamo denunciando)

per non parlare di quell’altro che su questo sito nega le mutazioni batteriche provocate dalla pressione selettiva degli antibiotici,prova in vitro della validita’ del modello evoluzionista.Nonche’ fenomeno che verifichiamo quotidianamente noi medici,soprattutto noi rianimatori in terapia intensiva. davvero una vergogna questa disinformazione.Su cose cosi’ serie poi.

avete visto paolini ieri sera? ha raccontato cosa succede quando si mettono le proprie credenze religiose davanni all’obiettivita’ dei fatti.

Ravvedetevi.Forse non lo capite ma e’ la religione che cercate di difendere a uscirne male,non certo il mondo della scienza che vi ignora.

Mmmmh. Mi può spiegare cos’è che verificate voi rianimatori in terapia intensiva? Sono alquanto dubbioso sul fatto che lei sappia veramente ciò di cui sta parlando. E prima che io assurga Paolini a modello di riferimento per le mie opinioni dovrò subirne parecchie di lobotomie.

e perche’ non farsi anche grasse risate con nature in mano, eh? vuoi mettere con quegli articoli geniali di “fisica della resurrezione” e di “biologia non darwininiana” che si trovano qui?

Sulla fisica della resurrezione, sinceramente nutro parecchi dubbi anch’io. Sulla biologia non darwiniana, credo che un’occhiata e un minimo di credito le si possa dare, almeno dal punto di vista epistemologico, senza tirare in ballo creatori i progettisti. Anche perché spero che anche se da un po’ di tempo si cerca di evitarlo, la scienza è formata anche da persone che propongono dei cambi radicali di vedute, e la cui attività non è solo compiacersi di quanto siamo bravi e di quanto è bella la scienza che possediamo.

Buonasera Ettore, sono “quell’altro” che nega l’evoluzione attuale dei batteri, se veramente lei è un medico intervengo per consentirle di aggiornarsi sulla resistenza dei batteri agli antibiotici.

Sull’argomento ho giusto pubblicato ieri un articolo:

http://www.enzopennetta.it/wordpress/2012/04/ancora-una-smentita-allevoluzione-dei-batteri/

Questa, come vede è informazione, la disinformazione la farà qualcun altro.

senta sig. Pennetta,io sono semplicemente allibito e sconcertato dalle asserzioni del suo articolo. ma si rende conto di quello che dice? guardi che il fatto che lei cita non contraddice in nulla la comparsa in vivo di ceppi di batteri resistenti,CHE PRIMA NON LO ERANO. Questi fenomeni li osserviamo quotidianamente ! Ma come si sogna di scrivere cose del genere ?? ma ha idea di quante campagne vengono fatte negli ospedali di tutto il mondo contro l’uso improprio degli antibiotici proprio per questo fatto? ma non crede di doversi informare un pochino meglio prima di negare migliaia di pubblicazioni e centinaia di migliaia di osservazioni di medici ? Guardi,Pennetta,che nella mia esperienza ho visto con i miei occhi almeno una quarantina di casi negli ultimi 10 anni in cui Ps Aeruginosa ,prima sensibile ad un antibiotico,non lo era piu’ dopo uno o due cicli di antibiotico. e questo solo per lo Pseudomonas..per non parlare dei malati di fibrosi cistica che muoiono tutti regolarmente per infezione da batterio poliresistente dopo decine di cicli di terapie antibiotiche !!! SI chiama pressione selettiva,e non e’ contraddetta dal fatto che un certo plasmodio che conferisce resistenza fosse gia’ presente nel precambriano ! ma che sta dicendo??? si informi,lei non puo’ scrivere queste cose ?!?! si informi !!

che significa poi quello che scrive ?? ma che significa??? ma ha idea di quante strategie possiede un procariota per difendersi da un antibiotico…ma che dice??

senta ,guardi,io trovo la vostra operazione semplicemente sconcertante,ma per voi, non certo per il mondo della scienza o quello della medicina.per voi,credetemi. io non capisco come possiate scrivere cose del genere senza porvi anche una questione etica,con tanta faciloneria e tanto sensazionalismo. “ognuno pensa quello che vuole” mi scriveva un suo sodale.non posso che ribadire, anche a lei, che la scienza e il sapere sono beni troppo preziosi e vitali per poterli piegare alle proprie credenze religiose.

mi creda sono sconcertato dal vostro atteggiamento. lo credevo sepolto tra i relitti della storia del 900.

Spero possiate avere molta pubblicita’,state rendendo alla vostra religione un servizio davvero pessimo.O forse quello che essa merita in questo scampolo di millennio,chissa’.

“incremento di informazione”..sempre con questa strana locuzione poi…ma che significa??? il batterio MRSA possiede un gene per la beta lattamasi,e quando viene selezionato rappresenta la base per ulteriori eventuali mutazioni..che significa “incremento di informazione” ?? ma che scrive?? ma quando mai gli evoluzionisti hanno misurato l'”incremento di informazione” di una struttura biologica?? ogni cosa in biologia viene considerata nel suo contesto..la mancanza della gp105 che conferisce resistenza all’infezione hiv nell’uomo non e’ “incremento di informazione” (ma che significa poi?? ma che significa??)ma e’ un carattere,punto e basta. che poi oltre a conferire resistenza all’hiv l’assenza di questa abbia anche altre implicazioni,o potra’ averle in futuro,se un giorno vivranno solo uomini senza questo gene,questo e’ ovvio ! Non c’e’ “incremento di informazione” nell’evoluzione..ma chi le ha messo in testa questa cosa? ci saranno speciazione,differenziazione semmai.un gatto o uno scimpanze’ non hanno “meno informazione” di un uomo…semplicemente sono diversi.informazione rispetto a cosa poi? mah… roba da pazzi.

Guardi, Pennetta, che l’informazione scientifica la facciamo cosi’ nel 2012 :

http://mmbr.asm.org/content/74/3/417.full

http://www.nature.com/nrmicro/journal/v7/n8/full/nrmicro2197.html

http://www.ncbi.nlm.nih.gov/pmc/articles/PMC128759/

http://www.nursing.columbia.edu/CIRAR/Presentation_Slides/Ratner_11.29.07.pdf

http://www.christs.cam.ac.uk/darwin200/pages/index.php?page_id=g1

http://www.actionbioscience.org/evolution/futuyma.html

Questo e’ in italiano,per la sua prossima conferenza all’associazione dei bravi genitori …

http://www.lescienze.it/news/2012/04/08/news/evoluzione_dei_batteri_scambio_geni_diffusione_variazioni_genetiche_popolazioni_divergenti_habitat_applicabilit_del_concetto-950982/

a tutti gli altri che non hanno avuto i bravi (e buoni) genitori una carrellata di altri articoli veramente interessanti sul tema darwinismo-microbiologia :

http://mmbr.asm.org/content/73/1/13.full

http://mmbr.asm.org/content/68/2/173.full?sid=3885e337-1e81-435d-ada9-de8aa27d3f4a

http://mmbr.asm.org/content/73/2/371.full?sid=3885e337-1e81-435d-ada9-de8aa27d3f4a

http://mmbr.asm.org/content/65/1/151.full?sid=f3644bfd-5173-4550-8ed4-dad1310b10a0

Chi non ha avuto un “bravo genitore” (il mio era un fisico nucleare) del resto deve imparare a camminare sulle sue gambe..senza spintarelle..o no?

Grazie ettore per il suo intervento, lo trovo molto interessante, ma non vedo alcuna smentita di quanto sostiene il prof.Pennetta. La invito perciò innanzitutto a calmarsi un attimo. Non cerchi quindi di dipingerci come degli sciocchi invasati perchè non funziona. Credo che nessuno qui stia mettendo in discussione le buone pratiche ospedaliere relativamente all’assunzione di antibiotici e la possibilità degli stessi batteri di sviluppare (o manifestare) antibiotico resistenza. Qui si sta parlando di EVOLUZIONE dei batteri.

Gli esempi che lei riporta nei link che ha citato sono molto simili a quanto avviene anche nell’uomo stesso in popolazioni dove vi è un alta incidenza di una particolare malattia. L’esempio classico è quello della malaria e dell’insorgenza nell’uomo dell’anemia mediterranea che rende immuni alle forme più gravi di malaria. Ma il fatto è che un uomo affetto da talassemia è e resta pursempre un uomo. E così come l’uomo nella maggior parte dei casi soffre un costo biologico (anemia) per poter

essere immune alla malattia anche questo succede nei batteri.

Quindi, che le mutazioni esistano, nei batteri tanto quanto negli organismi più complessi nessuno lo mette in dubbio. Ma da qui a parlare di salto evolutivo (nuova specie) a causa della pressione degli agenti esterni ce ne passa. Tanto è vero che uno Staffilococco Aureo resistente agli antibiotici resta pursempre uno Staffilococco Aureo.

Concordo con te Gabriele; inoltre sono molto curioso di attendere le repliche delle persone chiamate in causa da Ettore: gli daranno filo da torcere….

Penso che il prof. Pennetta ormai si sia stancato di rispondere. Comunque, siccome questa stanchezza sta contagiando anche me, per il prossimo futuro sto programmando di estraniarmi dalla discussione e suggerire invece uno studio antropologico sull’uso dell’argomento scientifico da parte delle persone che ne parlano a vanvera. La scintilla di quest’idea mi è scattata quando l’utente “alfonsotoscano” sparò in faccia al Masiero: “Tu non capisci nulla di fisica! La Terra non è stata creata da Dio, ma dai residui di un precedente sole!!”. Come si può non considerare una frase del genere (pronunciata in faccia a chi, poi) come il frutto di un condizionamento culturale pesante?

e’ vero. invece uno pseudomonas aeruginosa poliresistente diventa uno stenotrophomonas maltophilia. Che facciamo..giochiamo con le parole?

vedi gabriele,lasciando perdere i batteri su cui chi vuole leggera’ sotto, ti diro’ che in fondo le argomentazioni assurde di Pennetta potrebbero avrebbero un qualche senso se il DNA degli organismi formati da eucarioti fossero tra loro profondamente diversi. il fatto e’ che il dna di un lombrico e’ identico a quello umano per oltre il 90%. e’ questo fatto che ci fa capire come l’evoluzione sia lenta nel tempo,ma sfrutti cio’ che gia’ esiste nel mondo. la comparsa di mutazioni e’ un fatto,il fatto che alcuni sottogeneri soltanto sopravvivano a una pressione selettiva la vera molla dell’evoluzione. E che piaccia o no a questi simpatici divulgatori che ridono di nature e deridono il pubblico (era fatto di fisici e scienziati) di Paolini dell’altra sera,questi fenomeni da soli bastano a fornire una spiegazione teorica dell’evoluzione.l’esempio dell’anemia falciforme e’ giusto e pertinente..che devo aggiungere?

Già… lo pseudomonas è un batterio, mentre invece lo stenotrophomonas è… un batterio… e perché non ricordare che è stato classificato a suo tempo come Xanthomonas… e poi le argomentazioni assurde sarebbero quelle di Pennetta (resterebbe da spiegare, comunque, almeno la resistenza preventiva agli antibiotici: trattasi di muffe? Certo, ma come la mettiamo con quelli di sintesi?)

non credo che nessuno qui possa osservare in vivo lo sviluppo di una nuova specie nel senso stretto…si tratta di processi troppo lunghi. ed in effetti non e’ corretto parlare di “evoluzione dei batteri” e non l’ho fatto. e tuttavia si tratta di fenomeni che microscopicamente confermano la teoria di darwin in maniera davvero potente.il fatto poi che nuove specie siano comparse nell’arco di milioni di anni…beh questo e’ un fatto.

ho fatto l’esempio degli ominidi : in contemporanea vi furono almeno cinque linee evolutive in europa e in asia probabilmente provenienti da ondate migratorie da un antenato comune africano strettamente simili dal punto di vista della genetica quantitativa,ma molto diverse fenotipicamente.Alcune di queste linee (oltre alla nostra) pare avessero addirittura una sorta di cultura,di linguaggio,di culto dei morti.

Certo come contraddire chi mescola metafisica e scienza? di per se’ gli assunti dell’ID non sono falsificabili in quanto non sono scientifici…sono articoli di fede.certo che negare la speciazione,nel 2012,e’ davvero sconcertante a fronte della mole di prove genetiche e fossili.onestamente non ho la piu’ pallida idea di dove questa gente voglia andare a parare.Mi piacerebbe sentire il loro contributo alla teoria,la loro spiegazione.La prossima puntata di Voyager…? chissa’….

A proposito ancora di stenotrophomonas maltophilia, ma non era già conosciuto nel 1933, cioè solo 5 anni dopo la scoperta della penicillina e almeno 5 anni prima del suo uso massiccio e per di più quasi esclusivamente in medicina militare?

E’ bello avere degli ammiratori…! Comunque non ho mai detto che rido di Nature, solo che in alcune riviste scientifiche mi capita di leggere affermazioni azzardate o fuori luogo, che mi fanno fare un bella risata lì per lì. Nient’altro.

Aiggungo, rispetto agli utlimi 3 link da lei citati, che sono tutti interessantissmi, per carità, però io non vedo ancora alcuna smentita alla tesi del prof. Pennetta:

– Il primo è una dissertazione sulla storia della biologia, che per quanto interessante non entra nel merito della questione posta dall’articolo.

– Il secondo è ancora una volta uno scenario (e lei ben sa cosa sono gli scenari) di come “potrebbe” essersi formata la via. Interessantissimo, ma come al solito le precondizioni sono tantissime (che al loro volta fanno riferimento ad altre teorie, notare l’accumularsi dei castelli di carta, ovvero di teoria sopra teoria) e di dimostrazione pratica nemmeno l’ombra.

– Il terzo parla di virus. Qui ci potrebbe stare la solita interessante discussione sul fatto che i virus siano o meno veri essere viventi, ma sicuramente non dice nulla sull’evoluzione attuale dei batteri.

Stavo per classificare l’articolo di Pennetta come una delle solite idee lanciate che, chissà, potevano portare a nuove deduzioni scientifiche da aggiungere e non da sostituire a quelle darwiniane. Infatti la generalizzazione, l’astrattezza e la pochezza di contenuti non permettevano di fare deduzioni. Tutte le affermazioni sono in linea di principio valide e falsificabili, è da qui che parte la neutralità della scienza: la selezione sessuale, la variabilità genetica casuale, la competizione tra predatori, prede e parassiti, l’epigenetica, le relazioni tra vita e ambiente, l’istinto, la coscienza, l’anima, Dio…

Tuttavia mi sono trattenuto dal giudicare perchè poi sono incappato nella descrizione, questa sì genuinamente scientifica, della trasmigrazione orizzontale dei geni, cioè lo scambio del corredo genetico tra il batterio sopravvissuto alla natura maligna e gli altri batteri.

Possibile che non si sia colta la pienezza delle idee darwiniane in questo passo? Le domande scientifiche sono:

1) Perchè quel superbatterio aveva quel gene che gli altri non avevano? Se si esclude la variabilità genetica casuale tipica del neodarwinismo, quale altra spiegazione dare? A meno di non essere così ferocemente antidarwiniani da escludere che i geni possano avere una funzione.

2) Perchè i batteri possono scambiarsi i geni tramite plasmidi, mentre per gli organismi pluricellulari è necessaria la riproduzione per scegliere i geni da trasmettere alla prole?

3) Se i geni vengono accesi, spenti, scambiati di continuo, allora a quale livello dovrebbe situarsi la perfezione tanto amata dai cultori del finalismo, dagli esteti dello scopo primo della natura?

Ma per favore: “prova in vitro del modello evoluzionista”… Ma Ella ha mai verificato che un batterio si sia trasformato in qualcosa di diverso da un batterio stesso? Quanto all’antibioticoresistenza è stato semplicemente osservato che in alcuni casi si è sviluppata nei batteri qualche migliaio di anni prima dell’uso massiccio di antibiotici naturali, per non parlare della sintesi di quelli “costruiti” in laboratorio, tanto che giustamente ha parlato di pressione selettiva. Dove starebbe il problema? O non vorrà ripetere le considerazioni del sedicente docente universitario Wallace? Il problema è che lo scientismo miope che le Sue osservazioni suggeriscono è il maggior ostacolo a qualunque sviluppo della scienza: si ravveda, anche perché se qualcosa o qualcuno esce male da questa discussione non è certo la religione…

A proposito, in quale ospedale lavora? Sa, vorrei proprio evitare i dintorni di quella città, per non correre rischi inutili (ovviamente per il pericolo di trascendere incontrandoLa personalmente, non certo perché, come qualcuno malignamente potrebbe pensare, io metta in dubbio le Sue sicuramente notevoli capacità mediche)

Non ci sarebbe molto altro da aggiungere a quanto affermato da Gabriele e Paolo,intervengo solo per confermare che ettore interviene con degli argomenti che dimostrano solo che non ha letto, o probabilmente finge di non capire quello che viene detto nei miei articoli.

Continua a parlare di casi di “selezione” fingendo di non sapere che l’esistenza delle selezione non viene messa in dubbio da nessuno e si sofferma a insistere sui casi di resistenza senza capire che sono conseguenti a trasmissione orizzontale o a perdita di funzione e che quindi non sono la prova di alcuna evoluzione o nuovo carattere.

La prova del fatto che ettore non porta nessun argomento nuovo, e che non voglia capire che l’evoluzione non può essere provata con meccanismi che portano ad una perdita di funzione, è data dal suo riproporre l’anemia mediterranea come prova di evoluzione, buttando poi in mezzo in modo arbitrario s. Anselmo: legga bene le nostre obiezioni, il darwinismo è contro la ragione, non contro la religione.

Inoltre, lei che è medico, se l’anemia mediterranea dimostra l’evoluzione lo vada a dire a coloro che ne sono colpiti!

L’esempio dell’nemia mediterranea è poi del tutto assimilabile a quelli riportati nel video che ho linkato nel mio articolo, e che evidentemente ettore non ha visto:

http://www.enzopennetta.it/wordpress/2012/04/ancora-una-smentita-allevoluzione-dei-batteri/

Infine un consiglio… ettore, non si scaldi tanto, non è con i ripetuti punti interrogativi o con l’atteggiamento insolente che si dimostra di aver ragione.

Chiedo scusa, ma “per dare a Cesare quel che gli appartiene” dobbiamo dire che Ettore ha parlato non di anemia mediterranea ma di anemia falciforme, conosciuta anche come “favismo”,poco paragonabile alla vera anemia mediterranea anche se certamente poco piacevole per chi ne è affetto… ciò ovviamente non cambia nulla di tutto il resto. Chiedo ancora scusa per la puntualizzazione…

Direi che stiamo parlando dello stesso fenomeno, sia che lo chiamiamo anemia falciforme o anemia mediterranea, il punto che interessa è che la resistenza al Plasmodium falciparum viene conferita a prezzo di un peggioramento della funzionalità degli eritrociti.

http://www.lescienze.it/news/2011/11/13/news/ecco_perch_lanemia_falciforme_protegge_dalla_malaria-658612/

certo, il fenomeno di base è lo stesso, ma la falcemia può in effetti essere protettiva per circa metà popolazione (quella femminile eterozigote) in caso di malaria, mentre ad esempio l’anemia mediterranea vera e propria è assai più pericolosa

io invece sono alquanto dubbioso che ella abbia una benche’ minima compentenza scientifica. la invito a continuare a “tenere pulito” il suo bel sito da chi vi diffama. non c’e’ niente di peggio che parlare con derisione e con disprezzo di chi ha dedicato la propria vita e la propia fatica al progresso della scienza,spesso contro i pregiudizi violenti e arroganti delle religioni rilevate.

sono sicuro che le prossime puntate di Voyager saranno tutte per voi.

tanti saluti.

Ma perché non esplicita i dubbi sulle competenze scientifiche invece di usare toni ultimativi e dispregiativi?

io invece sono alquanto dubbioso che ella abbia una benche’ minima compentenza scientifica. la invito a continuare a “tenere pulito” il suo bel sito da chi vi diffama. non c’e’ niente di peggio che parlare con derisione e con disprezzo di chi ha dedicato la propria vita e la propia fatica al progresso della scienza,spesso contro i pregiudizi violenti e arroganti delle religioni rilevate.

sono sicuro che le prossime puntate di Voyager saranno tutte per voi.

tanti saluti

ettore… commento solo occasionalmente ma posso assicurarti che in questo blog non si censura nessuno per le idee.

Mhhh… commento copia del precedente: compulsione ripetitiva o problemi di tastiera?

@Ettore :

Quoto cio’ che ha scritto !

Come vede questi “scientifici” e « intellettuali » cattolici si limitano solamente a mettere il POLLICE GIU’ ai sui intelligibili, scientifici e dettagliati commenti; ma non danno nessura risposta pertinente in merito !!! Noti inoltre le false simmetrie che si trovano puntualmente nei loro articoli…..La storia si ripete, purtroppo !

Io ho messo il pollice giù perché tutti gli interventi di Ettore sono OT, tutto qua. Se sempre più scienziati non si accontentano di “spiegare” con il caso o con la panspermia l’origine della vita e sollecitano una ricerca scientifica basata sulle leggi della fisica, che bisogno aveva questo signore di scaldarsi, offendere, e tirare fuori la sua cultura medica?

Caro Ettore, caro Pendesini: se davvero noi siamo soltanto il prodotto del caso e della necessita’ in ultima analisi non siamo altro che macchine costruite per la sopravvivenza. Siamo solo un mucchietto di atomi insignificanti che si danno la pena di vivere, per di piu’ illudendosi di formare un individuo consapevole di esistere solo perche’ cio’ comporta un guadagno biologico selettivo. Perche’ quindi vi scaldate cosi’ tanto per difendere le vostre idee? Non sono forse al pari di quelle di noi (illusi credenti) solo vane illusioni in un mondo senza senso e senza scopo?

Per quanto mi riguarda Alessandro ho appena risposto poco sopra ad Ettore… spero possa trovare la risposta sufficentemente pertinente.

Non dubito che lei quoti ciò che dice Ettore, comunque apprezzo il suo tono più rispettoso.

Ora, poiché suppongo che a quest’ora Ettore si trovi nel suo reparto rianimazione a verificare la speciazione in atto dei batteri, mi rivolgo a lei, che probabilmente è in linea.

Ettore scrive che l’argomento della proteina contenente la minima informazione possibile è opinabile. Supponiamo che sia vero (e io penso che sia così): mi può spiegare come si fa allora a insinuare che l’argomento della “scienza ufficiale” (???), che più o meno sostiene “eh, ma non si può sapere quanti aminoacidi contenesse quella proteina, non sappiamo che funzione potesse avere, forse c’è stato un colpo di fortuna, insomma, oggi siamo qui quindi vuol dire che in qualche modo è avvenuto” sia più valido di un calcolo statistico?

Lei dice che i commenti di Ettore sono dettagliati: io ho letto solo risate e accuse di incompetenza. Poi c’è stata una citazione sul fatto che i rami del genere Homo sono cinque, e contemporaneamente l’affermazione che i fossili mostrano un progressivo aumento di volume; due affermazioni che si contraddicono, perché se i rami sono paralleli allora i valori dei volumi non sono in relazione tra loro.

Lei dice che i commenti di Ettore sono scientifici: io ho visto un fiume di parole, sproloqui, accuse, nessun calcolo e dati oggettivamente discutibili circa l’inesistenza pregressa di un plasmide resistente nei batteri, seguita dall’affermazione che il batterio possiede numerose strategie di difesa (il che significa che le aveva anche prima dell’esposizione all’antibiotico)… E comunque ribadisco: non credo sia la pubblicazione su una rivista che rende un argomento scientifico, ma le caratteristiche intrinseche della trattazione, indipendentemente dallo spazio in cui sono ospitate.

La speciazione in alto dei batteri è fantastica 😉

Se non vede le risposte pertinenti non so che fare. Magari evidenzi le false simmetrie di cui parla e ci metta a tacere. Per ora, altro “dito giù” ma almeno firmato

il commento sopra era per alessandro pendesini e non per Daphnos…

E’ arrivato pendesini 😀

Quello che ricicla i commenti…

Attendo che Ettore, aiutato dal buon riciclatore, vorranno entrare nel merito dell’articolo. Possono farsi aiutare anche da altri amici se ne hanno bisogno.

Ben vengano; intanto il Dott. Ettore potrebbe farci vedere dove mai l’articolo o gli altri interventi, come egli sostiene nel commento delle 14.53, abbiano mescolato metafisica e scienza.

“Inoltre, lei che è medico, se l’anemia mediterranea dimostra l’evoluzione lo vada a dire a coloro che ne sono colpiti!”

guardi Pennetta che questa non e’ matematica o filosofia o logica. la scienza non “dimostra” nulla in modo assolutamente certo.Come pensa che possa dimostrarle l’evoluzione dei geni di un ominide in una paginetta di internet? Che il dna degli organismi si modifichi,e che si modifichino i geni e dunque anche i caratteri nel lungo periodo,questo e’ un fatto ritenuto provato da una mole enorme di osservazioni fossili e non,suffragato dalle osservazioni in vitro,anche quelle dei batteri. ho citato il fatto dell’anemia falciforme perche’ questa e’ piu frequente nelle aree colpite dalla malaria. e questo e’ molto probabilmente un fenomeno evolutivo provocato dalla selezione naturale in atto in quelle regioni.Chi puo’ dire quali saranno le conseguenze evolutive di questo? Non e’ forse un nuovo “carattere” possedere globuli rossi a falce o a orecchietta? un altro esempio simile e’ quello dell’emoglobina Lepore piu’ frequente in Sicilia,altro tentativo adattativo in zone colpite dalla malaria.

E io che dovrei dire e a chi ? ma cosa sta dicendo ?